Escucha este artículo en formato podcast:

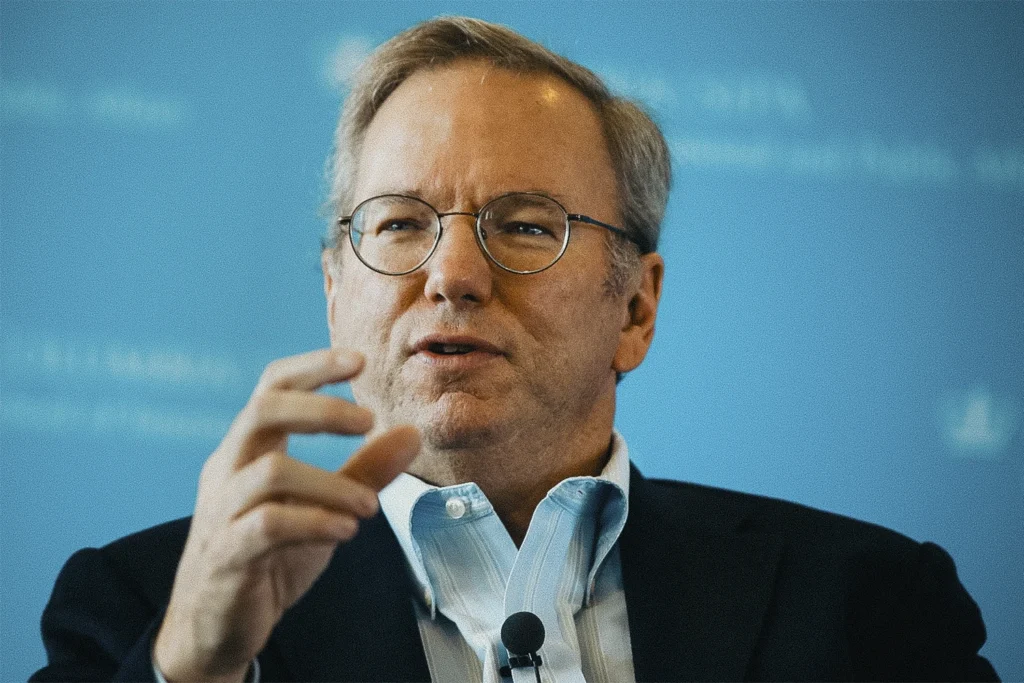

“Internet va a desaparecer”. Esta fue la declaración de Eric Schmidt, entonces presidente ejecutivo de Google, hace diez años en el Foro Económico Mundial. “Habrá tantos dispositivos, sensores y cosas que llevarás puestas o con las que interactuarás, que ni siquiera lo percibirás; formarán parte de tu presencia en todo momento”. Schmidt explicaba que la red se volvería invisible; pasaría a formar parte de nuestra presencia en todo momento. En aquel entonces, su idea era que internet dejaría de ser un sitio al que “entrábamos” para convertirse en el entorno en el que existimos.

Y no se equivocó. En las últimas décadas, la web se ha convertido en la plataforma donde la humanidad se ha volcado por completo. Es una extensión de nuestra existencia al permitirnos ir más allá de nuestras limitaciones físicas; es el lugar donde reside nuestra memoria y el medio en el que pasamos la mayor parte del tiempo. En cierto sentido, internet terminó siendo un espejo de lo que somos, con todas nuestras bondades y defectos.

Sin embargo, la inteligencia artificial le está dando a la predicción de Schmidt un giro mucho más literal y preocupante. Hoy, internet está en peligro de extinción; estamos presenciando su desaparición en tiempo real. A medida que la red se satura de contenido generado por IA generativa, el espacio que los seres humanos construimos durante décadas está siendo invadido y sustituido. Si antes la red servía para ampliar la presencia del ser humano, hoy parece que el hombre está siendo desplazado para que la máquina ocupe su lugar.

Por supuesto, quienes impulsan la IA insisten en que ahora es mucho más fácil crear contenido y que cualquiera puede tener una presencia digital. Pero, ¿qué aspecto tendrá un internet donde todo ha sido intervenido por algoritmos? ¿De qué manera esta automatización masiva amenaza la red tal como la conocemos? Y, sobre todo, ¿qué implica esto para el pueblo de Dios?

La era de la “BazofIA”

En la actualidad, la atención humana es un producto de inmenso valor. Millones de dólares se invierten cada día para captar nuestro interés a través de videos en Instagram, música en Spotify o series en Netflix. Como sociedad, llevamos años lidiando con los efectos de la superficialidad en las redes sociales, donde a menudo nos perdemos en la efímera dinámica de hacer un scroll interminable de videos graciosos. Pero, aunque todavía no hemos terminado de entender las consecuencias de esa exposición constante, la inteligencia artificial está agravando el problema.

El concepto central aquí es la “BazofIA” (o AI slop). Este término se refiere a la enorme cantidad de contenido de baja calidad generado por IA que inunda la red, similar al spam. Se empezó a utilizar de manera masiva tras la integración de modelos como Gemini en las búsquedas de Google, y hoy describe perfectamente un fenómeno estadístico: las cifras recientes son contundentes. De acuerdo con un estudio realizado por Ahrefs, de 900.000 nuevas páginas web creadas en abril de 2025, el 74% incluyen contenido generado con IA. Asimismo, según el estudio Are We in the AI-Generated Text World Already? Quantifying and Monitoring AIGT on Social Media (¿Ya estamos en el mundo del texto generado por IA? Cuantificación y supervisión del AIGT en las redes sociales), el 40% del nuevo contenido publicado en plataformas como Medium y Quora fue generado por IA.

Este cambio tiene un efecto directo en la calidad de lo que consumimos. Pensemos, por ejemplo, en YouTube. Si bien esta plataforma nunca ha sido ideal para encomendarle la educación de nuestros hijos, hoy se está volviendo todavía menos confiable de lo que solía ser. Hasta hoy, en medio de los muchos videos inútiles, ha sido posible encontrar joyas que demuestran un amplio trabajo artesanal de investigación y edición, particularmente en canales que, con miles de suscriptores, tienen una autoridad incuestionable. Sin embargo, estamos viendo cada vez más canales completamente automatizados con IA, donde todo —desde el guion hasta la voz— ha sido hecho por una máquina.

Lamentablemente, este avance parece difícil de frenar. Como la atención es tan valiosa y producir contenido humano es costoso, la “BazofIA” se presenta como la solución perfecta para los algoritmos: una herramienta de IA hace en segundos lo que a un creador real le toma meses. El resultado es que el contenido barato y automático termina desplazando poco a poco la presencia humana —quiero decir, verdaderamente humana— de la red.

La imposibilidad de distinguir la verdad de la mentira

Eric Schmidt dejó otra frase para la posteridad que hoy cobra un sentido alarmante: “Internet es lo primero que la humanidad ha creado pero no puede entender; es el mayor experimento de anarquía que hemos tenido”. Durante décadas, esa anarquía se manifestó como un caos donde convivían tesoros del conocimiento y basura digital. Sin embargo, a partir del 2022, el desafío ha mutado. Ya no se trata solo de que haya “basura” en la red, sino de que la frontera entre lo útil y lo inútil, lo real y lo falso, se está volviendo invisible.

Si un bloguero anónimo e ignorante en temas médicos publicaba sus propias opiniones sobre las mejores comidas para curar la ceguera, siempre existía la posibilidad de consultar investigaciones académicas (papers) de algún medio autorizado para corroborar la información. En otras palabras, casi siempre era evidente qué tan confiable era un sitio y su autor. Pero hoy esa distinción se está volviendo cada vez más difícil. Con la ayuda de la IA, el bloguero puede fabricar un artículo con apariencia científica en segundos y, por la forma en la que ahora funcionan las búsquedas, su escrito mediocre llegará a convertirse en una fuente autorizada.

Lo que ocurre con este bloguero es apenas un síntoma de un problema mucho más grave. Este escenario de incertidumbre, donde la apariencia de verdad sustituye a la verdad misma, se explica a través de los siguientes cuatro factores críticos:

1. La desmotivación del creador artesanal

El contenido que los seres humanos producen con esfuerzo, estudio y creatividad está siendo “cosechado” a una escala industrial por las grandes firmas tecnológicas. Si bien estas afirman que usan las creaciones humanas como una simple “inspiración”, en realidad se trata de un robo de identidad creativa para entrenar algoritmos sin consentimiento ni compensación.

El caso del director, animador, guionista y mangaka japonés Hayao Miyazaki es emblemático: su estilo visual, perfeccionado durante décadas de trabajo manual, hoy es tan reconocible que basta con un prompt para obtener imágenes que lo copian. Dado que estos modelos se entrenan con enormes colecciones de imágenes tomadas de la web, es posible generar resultados que imitan estilos ampliamente difundidos, como el asociado a Studio Ghibli. Esto genera una tragedia: los artistas y creadores serios se preguntan qué sentido tiene seguir innovando o investigando si su trabajo será devorado por una máquina que produce resultados a una velocidad inalcanzable para el ser humano. El resultado es un internet saturado de imitaciones vacías que desplazan a la verdadera innovación humana.

2. Un ecosistema dominado por “bots malos”

Nuestra percepción de lo que es popular o relevante en la red está siendo manipulada por entes no humanos. De acuerdo con la firma de ciberseguridad Imperva, por primera vez en la última década, la actividad de bots de IA en la web ha superado a la humana, representando el 51% de todo el tráfico en internet. Pero lo verdaderamente preocupante es el desglose de esa cifra: de ese 51%, el 37% son “malos bots”, es decir, programas diseñados para actividades como el scraping (robo masivo de datos), el spamming o ataques de denegación de servicio.

Esto rompe la brújula de la autoridad digital. ¿Cómo podemos confiar en que un sitio es importante porque tiene muchas visitas, si no sabemos si estas provienen de personas reales o de una legión de algoritmos diseñados para engañar al sistema y distorsionar las métricas?

3. El colapso del modelo: la serpiente que se come a sí misma

Existe una analogía que algunos analistas utilizan para describir el futuro de la inteligencia artificial: la de la serpiente que se come su propia cola. Si una serpiente se alimenta de otros animales, crecerá y se fortalecerá; pero si comienza a perseguir y devorar su propia cola, dejará de crecer y terminará por destruirse. Esto es lo que está sucediendo actualmente en el entorno digital. Debemos recordar que la IA no posee conciencia ni creatividad propia; es una máquina que se alimenta de datos masivos para procesarlos y devolver una respuesta basada en probabilidades.

En un principio, los modelos de IA fueron entrenados con un tesoro de información: datos tomados de internet que habían sido creados íntegramente por seres humanos a lo largo de décadas. En esa etapa, si la máquina cometía errores o presentaba “alucinaciones”, se debía principalmente a las imperfecciones técnicas de los modelos y no a la falta de calidad de la información con la que estaban siendo alimentados. Había una base sólida de verdad humana que servía como referencia.

Sin embargo, el panorama está cambiando drásticamente. A medida que internet se satura de “BazofIA”, los nuevos modelos están empezando a entrenarse con información que ya ha sido modificada o generada por otras máquinas. Estamos entrando en la era del “contenido de segunda generación”, un internet lleno de ecos artificiales que sirven de base para los modelos del futuro. Es un ciclo de retroalimentación donde la IA ya no aprende de la realidad humana, sino de sus propias versiones procesadas, lo que inevitablemente degrada la calidad del conocimiento.

Este fenómeno ha generado un intenso debate entre los expertos sobre lo que llaman el “colapso del modelo”. Algunos advierten que, si la IA continúa alimentándose de sí misma de forma predominante, el sistema sufrirá fallas críticas que lo harán inservible, perdiendo su conexión con la precisión y el sentido común humano. Otros son más optimistas y creen que el daño es rescatable. Pero todos coinciden en algo: el efecto es irreversible. Jamás volveremos a ver un internet puramente humano, y la información que consumamos estará marcada por esta degradación progresiva.

4. La institucionalización de la mentira

Como implicación directa de este proceso, la probabilidad de que cualquier contenido que encontremos en la red haya sido influenciado por la IA crecerá exponencialmente con el tiempo. En un mundo donde la eficiencia es la prioridad, dejar de usar estas herramientas significa simplemente perder la carrera por la relevancia. Pero esta velocidad tiene un costo oculto en la veracidad. La IA está diseñada con una capacidad asombrosa para presentar la información de manera creíble, vistiendo datos inciertos o erróneos con una apariencia de autoridad absoluta. No es que la máquina tenga una “intención oscura”; simplemente esa es la forma mecánica en la que procesa los datos para complacer al usuario.

El verdadero peligro surge cuando esta capacidad de convicción entra en el ciclo de consumo masivo. Si un dato falso o una interpretación errónea se convierte en un contenido con muchas vistas y adquiere una apariencia de confiabilidad, los nuevos modelos de IA echarán mano de ese error para seguir creando más información que terminará publicada en la red. En este ecosistema, en el que el volumen de la máquina supera al de la voz humana, una mentira puede transformarse en una “verdad” aceptada en cuestión de pocos años. Sin suficientes fuentes humanas con autoridad para desmentir el ruidoso flujo del slop, la desinformación deja de ser un error pasajero para convertirse en una institución difícil de derribar.

El llamado de la Iglesia en una red deshumanizada

Para los padres de las décadas de los 80 y 90, existía una sospecha natural frente a lo que aparecía en internet. Aunque el tiempo —especialmente el de la Pandemia— demostró que la web jamás reemplazará al mundo físico, gran parte de lo que se ha volcado en la red durante décadas realmente contiene el alma de nuestra especie. Sin embargo, ese legado hoy está en peligro. Debemos recuperar ese escepticismo inicial, pero ahora dirigido a la IA. La pregunta es: ¿será posible encontrar un blog escrito genuinamente por un ser humano en cinco años?

Decir que internet simplemente “se acabará” puede sonar extremo, pero lo innegable es que está mutando a una velocidad que compromete la comunicación de la verdad. Durante décadas, la Iglesia ha encontrado en la web una plataforma invaluable para publicar sermones, podcasts, videos, artículos y toda clase de contenidos que edifican al pueblo de Dios. Por eso mismo, hoy tenemos un llamado urgente a ser guardianes de la calidad y la humanidad en nuestras publicaciones.

Este llamado a la calidad exige una reevaluación profunda de nuestras expectativas. La IA puede servir como herramienta de apoyo, pero jamás debe usurpar el papel del autor en la fase de investigación y reflexión. La búsqueda de información es un ejercicio de discernimiento que requiere oración y pensamiento crítico. Un artículo que nace puramente de un algoritmo carece de convicciones; si el contenido no ha pasado primero por el filtro del corazón de un creyente, difícilmente podrá conectar con el alma de quien lo lee o inspirar una verdadera transformación.

Y el desafío de la confiabilidad espiritual es el más crítico. La Iglesia está llamada a ser “columna y sostén de la verdad” (1 Ti 3:15), pero en un ecosistema digital que se alimenta de sus propios errores, la mentira teológica se multiplicará por inercia algorítmica. Debemos recordar que la IA no posee discernimiento espiritual; para un modelo de lenguaje, un tratado de sana doctrina tiene el mismo peso estadístico y de contenido que un texto de sectas falsas. El riesgo es que la verdad del Evangelio quede diluida entre miles de contenidos superficiales.

Por lo tanto, nuestra generación tiene la tarea de luchar por una selectividad rigurosa en su dieta digital. Si el deslizamiento infinito en redes sociales ya representaba una amenaza, la llegada del contenido generado por IA eleva el peligro a otro nivel. Estamos siendo bombardeados por videos y artículos que, aunque proyectan una apariencia profesional, son en el fondo insignificantes. Como pueblo de Dios, no deberíamos permitir que nuestro tiempo sea devorado por máquinas diseñadas para retener nuestra atención a toda costa. Nuestra responsabilidad es filtrar con rigor lo que entra en nuestra mente, recordando que no todo lo que brilla en la red tiene valor eterno.

Nota del editor: Este artículo fue redactado por David Riaño y las ideas le pertenecen (a menos que se especifique explícitamente lo contrario). Para elaborarlo, ha utilizado herramientas de IA como apoyo. El autor ha revisado toda la participación de la IA en la construcción de su texto, y es el responsable final del contenido y la veracidad de este.

Referencias y bibliografía

Eric Schmidt: “The Internet Will Disappear” | CNBC – YouTube

La anarquía es internet | La Vanguardia

The Dead Internet Theory | Kurzgesagt – YouTube

74% of New Webpages Include AI Content | Ahrefs

Are We in the AI-Generated Text World Already? | Cornell University

What Happens When All Training Data is AI Generated? | Mutual Information – YouTube

Apoya a nuestra causa

Espero que este artículo te haya sido útil. Antes de que saltes a la próxima página, quería preguntarte si considerarías apoyar la misión de BITE.

Cada vez hay más voces alrededor de nosotros tratando de dirigir nuestros ojos a lo que el mundo considera valioso e importante. Por más de 10 años, en BITE hemos tratado de informar a nuestros lectores sobre la situación de la iglesia en el mundo, y sobre cómo ha lidiado con casos similares a través de la historia. Todo desde una cosmovisión bíblica. Espero que a través de los años hayas podido usar nuestros videos y artículos para tu propio crecimiento y en tu discipulado de otros.

Lo que tal vez no sabías es que BITE siempre ha sido sin fines de lucro y depende de lectores cómo tú. Si te gustaría seguir consultando los recursos de BITE en los años que vienen, ¿considerarías apoyarnos? ¿Cuánto gastas en un café o en un refresco? Con ese tipo de compromiso mensual, nos ayudarás a seguir sirviendo a ti, y a la iglesia del mundo hispanohablante. ¡Gracias por considerarlo!

En Cristo,

|

Giovanny Gómez Director de BITE |